Тюнинг Улучшения кузова Тюнинг Лады Приоры своими руками: улучшения кузова, салона, двигателя и ходовой

С 2007 года российский производитель машин ОАО «АвтоВАЗ» при участии итальянской студии “Carcerano” начал наполнять отечественный рынок автомобилями Лада Приора, полюбившимися покупателю невероятно привлекательной ценой и безграничными возможностями для тюнинга, даже своими руками, без обращения в специализированные сервисы.

Появление этого автомобиля создало новое направление в тюнинге — сделать из узнаваемого недорогого “железного коня” невероятно привлекательную машину, которая выделялась бы своим внешним видом и не уступала по техническим характеристикам более престижным авто. Подборка различных видео- и фотоматериалов из интернета помогут определиться с тюнингом именно вашей Приоры.

Условно полный тюнинг Приоры можно разделить на:

Итак, рассмотрим каждый этап изменений подробнее.

Начать тюнинг для ВАЗ Приора можно с изменений формы бамперов и капота. Установленные на машине универсальные упоры для капота решат проблему заводских недочетов.

Бампера, которые подойдут для тюнинга на Приору, можно купить без проблем. Облегченный “Снайпер”, “Я робот” из пластика, стеклопластиковые серии AVR по индивидуальному заказу, ставятся на заводские крепления машины и не требуют значительных доработок. Они не только помогают изменить форму, но и улучшить некоторые технические характеристики, например,увеличить скорость охлаждения двигателя появившимся широким воздухосборником.

Комплект «Я — робот»

Установка специальных пластиковых накладок-“юбок”, спойлеров и обвесов способно полностью преобразить внешний вид.

Не знаете как выбрать антирадар? Узнайте, на какие диапазоны радар-детекторов стоит обращать внимание в первую очередь.

Зимой водителям приходится каждое утро отогревать машину. Как сделать это быстро и без усилий читайте в нашей статье.

С измененными бамперами будет уместно тюнинговать решетку радиатора. Сделать обновленную решетку в виде полос, сот или другого рисунка решать только вам, но изменить ее можно только двумя способами:

Нелишним будет внести изменения в фары. Установка ресничек, билинз, тонировка задних фар повлияют на уникальность авто. А смена заводских ламповых габаритов на светодиоды не только уникализирует внешний вид, но и значительно усилит свечение с тусклого желтого на яркий, почти белый, свет. Можно модернизировать поворотники в габариты, что расширит их функциональную нагрузку.

Можно модернизировать поворотники в габариты, что расширит их функциональную нагрузку.

В завершении внешнего преобразования можно использовать винил для обтягивания всей машины или некоторых ее частей, порадовать себя “ноу-хау” и сделать карбоновое покрытие авто в 2D или 3D вариантах. Если любите аэрографию, то машина полностью готова воплотить в себе любую фантазию владельца.

Этот тюнинг хорошо подходит для приоры с любым кузовом — хэтчбек, седан или универсал.

Начать видоизменения в салоне можно с его освещения. Заводской плафон с лампой дают слишком тусклый однонаправленный свет. Существенных изменений достигните заменив плафон, поставив светодиоды вместо лампы накаливания, сместив центральное освещение салона. Можно подсветить ручки дверей , а наиболее смелым владельцам — установить светодиодные ленты под передними сиденьями, осветив пол машины.

Пластиковые детали салона обычно дополнительно обтягивают различными материалами. Это могут быть кожа и заменители или карбоновая пленка. Также перетяжке в салоне подвергаются передние и задние сиденья машины, где заводские чехлы меняются на сделанные под заказ. В последнее время на территории России, вытесняя кожу, вошли в моду чехлы из меха или флока, что обусловлено холодной погодой.

Это могут быть кожа и заменители или карбоновая пленка. Также перетяжке в салоне подвергаются передние и задние сиденья машины, где заводские чехлы меняются на сделанные под заказ. В последнее время на территории России, вытесняя кожу, вошли в моду чехлы из меха или флока, что обусловлено холодной погодой.

Переднюю панель машины самостоятельно видоизменить практически невозможно, поэтому для ее переделки лучше обратиться к специалистам. А вот в багажном отделении можно “поколдовать”:

На этом видео показан красивый салон тюнингованной приоры:

При правильном подходе можно увеличить мощность двигателя на 40 %. Установка механического нагнетателя (компрессора-суперчарджера), растачивание блоков цилиндра, замена поршней на низкие, а коленвала — на высокий, помогут сделать авто быстрее, но потребуют большего расхода топлива.

Улучшение динамических характеристик добиваются, поработав с карбюратором

. Натереть наждачной бумагой детали разобранного карбюратора и продуть каналы, сменить жиклер и насос ускорения, отрегулировать уровень топлива — и Лада Приора увеличит скорость разгона. А двухмембранный вакуумный усилитель, металлокерамические диски и новые пружины могут усовершенствовать тормозную систему.Никто не застрахован от разрядки АКБ в самый неподходящий момент. Читайте→ как быстро зарядить автомобильный аккумулятор в любых условиях.

Если вы умеете рисовать, то сможете без проблем сделать свое авто уникальным. Наша статья об аэрографии поможет вам в этом!

Как избежать штрафов за тонировку?? Не заходите сюда -→ /avtopravo/strafe/kakojj-shtraf-za-tonirovku.html, если у вас не тонированная машина.

Для начала необходимо продумать план преобразований и начать с самого простого, например, установки ДХО или противотуманных фар, освещения багажника или замены дверных ручек.

После того как будете готовы самостоятельно произвести более сложные изменения, поменяйте решетку радиатора, установите пневматическую подвеску или турбину. И только став настоящим мастером, ознакомьтесь с информацией о покраске автомобиля своими руками и установке дополнительной шумоизоляции.

Таким образом преобразив своего “железного друга” можно смело выезжать из гаража и удивлять окружающих достижениями тюнинга, не раскрывая секретов собственного мастерства. И в конце предлагаем взглянуть на видео-подборку крутых тюнингованных Приор:

Содержание

Лада Приора относится к тому типу автомобилей, которые пользуются популярностью у отечественных автомобилистов по той причине, что их можно сделать особенными. Приоры хорошо поддаются переделкам, тюнинг на несколько порядков повышает их эксплуатационные характеристики, экстерьер и интерьер, благодаря чему получаются очень крутые машины.

Приоры хорошо поддаются переделкам, тюнинг на несколько порядков повышает их эксплуатационные характеристики, экстерьер и интерьер, благодаря чему получаются очень крутые машины.

Ниже мы расскажем подробнее о том, как может быть осуществлён авто-тюнинг Приора – картинки помогут проиллюстрировать основные идеи для автомобиля, которые при этом можно применить.

Вы решили выделить из серой массы машин свой автомобиль? Тюнинг лады приоры — отличное решение!Самый простой тюнинг ВАЗ 2170 – это различные варианты покраски и оклейки автомобиля плёнкой. Ниже приводим в качестве примера фото автомобиля с аэрографией, которая полностью меняет его зрительное восприятие.

Авто-тюнинг обычно не обходится без замены бампера Приоры – на место штатного изделия обычно устанавливают современный обвес с нижней юбкой и улучшенными аэродинамическими показателями. Практика показала, что сделать новый бампер без труда самому – на улицах можно увидеть множество крутых машин с самодельными обвесами, которые выглядят гораздо эффектнее, чем заводские.

Для изготовления бампера автомобиля можно использовать собственный проект, либо найти что-нибудь подходящее в Интернете. Материалом для изготовления служит стекловолокно с эпоксидной смолой, либо монтажная пена, либо пенопласт – работая с ними, можно добиться очень впечатляющих результатов. На фото ниже показан пример того, что любой владелец авто может сделать своими руками.

Есть ещё одна важная деталь, которая бросается в глаза при просмотре этой картинки – машины смотрятся намного лучше с тюнингом радиаторной решётки Приоры. Полноценное охлаждение двигателя достигается за счёт увеличенной площади решётки, а защита от пыли и грязи эффективна по причине мелких ячеек. Такую сетку можно купить на рынке и смастерить из неё решётку для радиатора автомобиля.

Решетки на радиатор в настоящее время имеют множество видов и формНиже приводим ещё несколько идей оформления решётки радиатора – каждая из них по-своему интересна. Безусловно, возможности в этом плане ними не исчерпываются – это лишь несколько вариантов из бесконечного множества.

Очень эффектно выглядит модный обвес на передней части автомобиля в комплексе с тюнингованной оптикой – машина становится похожей на космический корабль.

При помощи обычных светодиодов можно установить на головные фонари автомобиля «ангельские глазки», которые существенно меняют его «выражение лица», придавая некоторую индивидуальность.

Очень много значит на Приора тюнинг колёс – простая замена дисков даёт поразительные результаты. Можно выбрать кованые или литые – это зависит от ваших предпочтений и финансовых возможностей.

Встречаются любители винтажных решений, которые устанавливают на диски колпаки в стиле ретро – сегодня они смотрятся довольно элегантно. Обратите внимание на белые «манжеты» – когда-то они были только на машинах у членов правительства, сегодня любой может их заиметь на собственном авто.

Самостоятельно и быстро произвести заметные изменения в экстерьере авто вполне возможно, если приобрести новые литые диски на ПриоруТюнинг задних фар Приоры столь же распространён, как и на передних фонарях – для этого можно использовать те же светодиоды.

Можно придумывать различные креативные варианты – некоторые из них, несмотря на свою простоту, придают внешнему виду определённый шарм.

Задние фонари можно просто выкрасить – это смотрится очень эффектно.

Для любителей необычных световых эффектов предлагается возможность организовать для своего автомобиля ярко-красную подсветку днища – в темноте она производит очень сильное впечатление.

От того, как выполнен интерьер автомобиля, зависит комфорт водителя и пассажиров. Поэтому автомобилисты уделяют этому вопросу очень большое значение – кроме восторга окружающих важны и собственные впечатления.

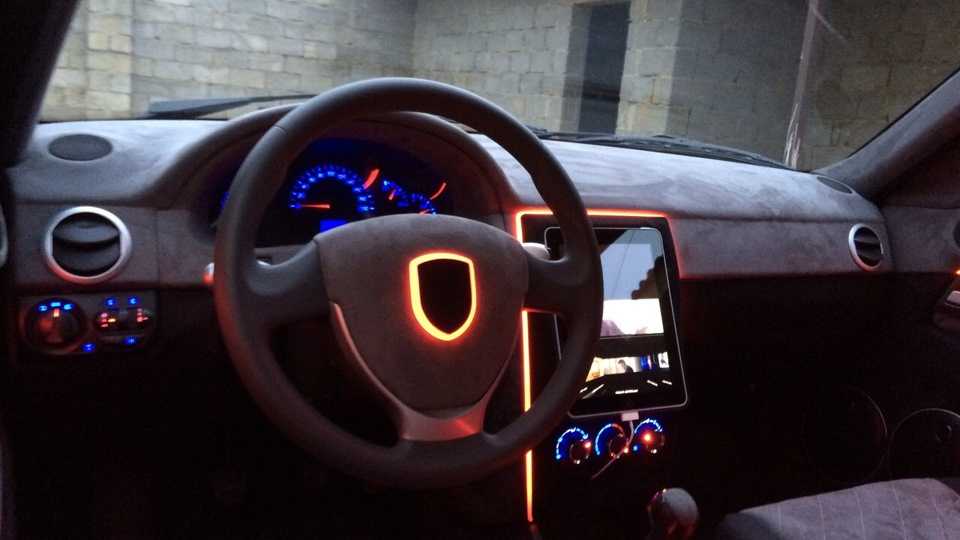

Приборная панель часто поддаётся различным переделкам – каждый старается организовать её таким образом, чтобы добиться эффектного дизайна и нужных функциональных возможностей.

Можно сменить обивку кресел и выполнить салон элегантной цветовой гамме – убедитесь сами, насколько красиво это выглядит. Хорошим материалом для перетяжки кресел является экокожа – она даёт привлекательный внешний вид и приятна наощупь.

Для пластиковых деталей салона можно предложить покраску и лакировку или обтягивание плёнкой – она даёт неплохие результаты.

Если вы любитель музыки – установите в салоне мультимедийную систему с серьёзной акустикой, это позволит не скучать в дороге. Колонки разместите под приборной панелью или на передних боковых дверях, а также сзади. Сабвуфер устанавливают в багажнике автомобиля – басы получаются на славу, а также очень серьёзная экономия места в салоне.

[democracy]

[democracy]

Опубликовано 7 ноября 2022 г. Обновление на GitHub

валгалла Сурадж Патил

pcuenq Педро Куэнка

9 из 9 Валентин Козин

гость

Dreambooth — это метод обучения новым концепциям стабильной диффузии с использованием специальной формы тонкой настройки. Некоторые люди использовали его с несколькими своими фотографиями, чтобы поместить себя в фантастические ситуации, в то время как другие используют его для включения новых стилей. 🧨 Диффузоры предоставляют обучающий скрипт Dreambooth. Обучение не занимает много времени, но сложно выбрать правильный набор гиперпараметров и легко переобучить.

Некоторые люди использовали его с несколькими своими фотографиями, чтобы поместить себя в фантастические ситуации, в то время как другие используют его для включения новых стилей. 🧨 Диффузоры предоставляют обучающий скрипт Dreambooth. Обучение не занимает много времени, но сложно выбрать правильный набор гиперпараметров и легко переобучить.

Мы провели множество экспериментов, чтобы проанализировать влияние различных настроек в Dreambooth. В этом посте представлены наши выводы и несколько советов по улучшению ваших результатов при точной настройке Stable Diffusion с помощью Dreambooth.

Прежде чем мы начнем, имейте в виду, что этот метод никогда не должен использоваться в злонамеренных целях, для причинения вреда или для выдачи себя за других людей без их ведома. Модели, обученные с его помощью, по-прежнему связаны лицензией CreativeML Open RAIL-M, которая регулирует распространение моделей Stable Diffusion.

Примечание: предыдущая версия этого поста была опубликована как отчет W&B .

fp16 обучение или накопление градиента, можно тренироваться на графических процессорах 16 ГБ, таких как те, которые предоставляются Google Colab или Kaggle. sks для обучения Dreambooth. Одна из первых реализаций использовала его, потому что это был редкий токен в словаре, но на самом деле это своего рода винтовка. Наши эксперименты, а также эксперименты, проведенные, например, @nitrosocke, показывают, что можно выбирать термины, которые вы обычно используете для описания своей цели.

Dreambooth очень быстро переоснащается. Чтобы получить хорошие результаты, настройте скорость обучения и количество шагов обучения таким образом, чтобы это имело смысл для вашего набора данных. В наших экспериментах (подробно описанных ниже) мы точно настроили четыре разных набора данных с высокой и низкой скоростью обучения. Во всех случаях мы получали лучшие результаты при низкой скорости обучения.

Все наши эксперименты проводились с использованием 9Скрипт 0007 train_dreambooth.py с оптимизатором AdamW на 2x 40 ГБ A100. Мы использовали одно и то же начальное значение и сохраняли одинаковыми все гиперпараметры для всех прогонов, кроме LR, количества шагов обучения и использования предварительного сохранения.

Для первых 3-х примеров (различные объекты) мы доработали модель с размером пакета 4 (2 на GPU) на 400 шагов. Мы использовали высокую скорость обучения 5e-6 и низкую скорость обучения 2e-6 . Предварительная консервация не использовалась.

Предварительная консервация не использовалась.

Последний эксперимент пытается добавить человека в модель. В данном случае мы использовали предварительное сохранение с размером пакета 2 (1 на GPU), 800 и 1200 шагов. Мы использовали высокую скорость обучения 5e-6 и низкую скорость обучения 2e-6 .

Обратите внимание, что вы можете использовать 8-битное обучение Adam, fp16 или накопление градиента, чтобы уменьшить требования к памяти и проводить аналогичные эксперименты на графических процессорах с 16 ГБ памяти.

Высокая скорость обучения ( 5e-6 )

Низкая скорость обучения ( 2e-6 )

Высокая скорость обучения ( 5e-6 ). Обратите внимание, что цветовые артефакты — это остатки шума — выполнение дополнительных шагов логического вывода может помочь разрешить некоторые из этих деталей.

Низкая скорость обучения ( 2e-6 )

Высокая скорость обучения ( 5e-6 ). Обратите внимание, что цветовые артефакты — это остатки шума — выполнение дополнительных шагов логического вывода может помочь разрешить некоторые из этих деталей.

Обратите внимание, что цветовые артефакты — это остатки шума — выполнение дополнительных шагов логического вывода может помочь разрешить некоторые из этих деталей.

Низкая скорость обучения ( 2e-6 )

Мы попытались включить персонажа Крамера из Seinfeld в Stable Diffusion. Как упоминалось ранее, мы обучались большему количеству шагов с меньшим размером партии. Тем не менее, результаты не были звездными. Ради краткости мы опустили эти примеры изображений и откладываем читателя к следующим разделам, где тренировка лица стала центром наших усилий.

Чтобы получить хорошие результаты при обучении Stable Diffusion с помощью Dreambooth, важно настроить скорость обучения и шаги обучения для вашего набора данных.

Лица труднее тренировать. В наших экспериментах скорость обучения 2e-6 с 400 тренировочных шагов хорошо работает для объектов, но для лиц требуется 1e-6 (или 2e-6 ) с ~ 1200 шагами.

Качество изображения сильно ухудшается, если модель переобучается, и это происходит, если:

Предварительное сохранение — это метод, использующий дополнительные изображения того же класса, который мы пытаемся обучить, как часть процесса тонкой настройки. Например, если мы попытаемся включить в модель нового человека, класс , который мы хотели бы сохранить, может быть человек . Предварительное сохранение пытается уменьшить переоснащение, используя фотографии нового человека в сочетании с фотографиями других людей. Приятно то, что мы можем генерировать эти дополнительные образы классов, используя саму модель стабильной диффузии! Сценарий обучения позаботится об этом автоматически, если вы хотите, но вы также можете предоставить папку с вашими собственными сохраненными изображениями.

Предварительное сохранение пытается уменьшить переоснащение, используя фотографии нового человека в сочетании с фотографиями других людей. Приятно то, что мы можем генерировать эти дополнительные образы классов, используя саму модель стабильной диффузии! Сценарий обучения позаботится об этом автоматически, если вы хотите, но вы также можете предоставить папку с вашими собственными сохраненными изображениями.

Предварительное сохранение, 1200 шагов, lr= 2e-6 .

Без предварительного сохранения, 1200 шагов, lr= 2e-6 .

Как видите, результаты лучше при использовании предварительной консервации, но шумные вкрапления все же есть. Пришло время для дополнительных трюков!

В предыдущих примерах мы использовали планировщик PNDM для выборки изображений в процессе вывода. Мы заметили, что при переобучении модели DDIM обычно работает намного лучше, чем PNDM и LMSDiscrete . Кроме того, качество можно улучшить, запустив вывод для большего количества шагов: 100 кажется хорошим выбором. Дополнительные шаги помогают преобразовать некоторые фрагменты шума в детали изображения.

Кроме того, качество можно улучшить, запустив вывод для большего количества шагов: 100 кажется хорошим выбором. Дополнительные шаги помогают преобразовать некоторые фрагменты шума в детали изображения.

PNDM , лицо Крамера

LMSDiscrete , лицо Крамера. Результаты ужасны!

DDIM , лицо Крамера. Намного лучше

Аналогичное поведение можно наблюдать и у других субъектов, хотя и в меньшей степени.

PNDM , Голова картофеля

LMSDiscrete , Картофельная головка

DDIM , Головка картофеля

В оригинальном документе Dreambooth описывается метод точной настройки компонента UNet модели, но кодировщик текста остается замороженным. Однако мы заметили, что точная настройка кодировщика дает лучшие результаты. Мы экспериментировали с этим подходом после того, как увидели его использование в других реализациях Dreambooth, и результаты поразительны!

Кодировщик замороженного текста

Тонко настроенный кодировщик текста

Точная настройка кодировщика текста дает наилучшие результаты, особенно с лицами. Он создает более реалистичные изображения, менее подвержен переоснащению, а также обеспечивает лучшую интерпретируемость подсказок, имея возможность обрабатывать более сложные подсказки.

Он создает более реалистичные изображения, менее подвержен переоснащению, а также обеспечивает лучшую интерпретируемость подсказок, имея возможность обрабатывать более сложные подсказки.

Мы также провели последний эксперимент, объединив Textual Inversion с Dreambooth. Оба метода преследуют одну и ту же цель, но их подходы различаются.

В этом эксперименте мы сначала запустили текстовую инверсию для 2000 шагов. Затем из этой модели мы запустили Dreambooth еще на 500 шагов, используя скорость обучения 1e-6 . Вот результаты:

Мы думаем, что результаты намного лучше, чем при использовании простого Dreambooth, но не так хороши, как при точной настройке всего текстового кодировщика. Кажется, что он немного больше копирует стиль тренировочных изображений, поэтому он может быть слишком подходящим для них. Мы не исследовали эту комбинацию дальше, но она может быть интересной альтернативой для улучшения Dreambooth и по-прежнему подходит для 16-гигабайтного графического процессора. Не стесняйтесь исследовать и рассказать нам о своих результатах!

Не стесняйтесь исследовать и рассказать нам о своих результатах!

DreamBooth — это метод персонализации моделей преобразования текста в изображение, таких как стабильная диффузия, для нескольких (3~5) изображений объекта.

Примеры Dreambooth из блога проекта.

Сценарий обучения Dreambooth показывает, как реализовать эту процедуру обучения на предварительно обученной модели стабильной диффузии.

Тонкая настройка Dreambooth очень чувствительна к гиперпараметрам и легко перенастраивается. Мы рекомендуем вам ознакомиться с нашим углубленным анализом с рекомендуемыми настройками для разных предметов и исходить из этого.

Перед запуском сценариев обязательно установите обучающие зависимости библиотеки. Также рекомендуем установить диффузоры из основной ветки на гитхабе.

pip установить git+https://github.com/huggingface/diffusers pip install -U -r диффузоры/примеры/dreambooth/requirements.txt

xFormers не является частью учебных требований, но мы рекомендуем вам установить его, если вы можете. Это может сделать ваше обучение более быстрым и менее интенсивным для памяти.

После настройки всех зависимостей вы можете настроить среду Accelerate с помощью:

конфигурации ускорения

В этом примере мы будем использовать модель версии v1-4 , поэтому, пожалуйста, посетите ее карточку и внимательно прочитайте лицензию перед процесс.

Приведенная ниже команда загрузит и кэширует веса модели из концентратора, поскольку мы используем идентификатор концентратора модели CompVis/stable-diffusion-v1-4 . Вы также можете клонировать репозиторий локально и использовать локальный путь в вашей системе, где была сохранена проверка.

В этом примере мы будем использовать эти изображения, чтобы добавить новую концепцию в Stable Diffusion с помощью процесса Dreambooth. Это будут наши тренировочные данные. Пожалуйста, скачайте их и разместите где-нибудь в вашей системе.

Это будут наши тренировочные данные. Пожалуйста, скачайте их и разместите где-нибудь в вашей системе.

Затем вы можете запустить сценарий обучения, используя:

export MODEL_NAME="CompVis/stable-diffusion-v1-4" экспорт INSTANCE_DIR="path_to_training_images" экспорт OUTPUT_DIR="path_to_saved_model" ускорить запуск train_dreambooth.py \ --pretrained_model_name_or_path=$MODEL_NAME \ --instance_data_dir=$INSTANCE_DIR \ --output_dir=$OUTPUT_DIR \ --instance_prompt="фото скс-собаки" \ --разрешение=512 \ --train_batch_size=1 \ --gradient_accumulation_steps=1 \ --learning_rate=5e-6 \ --lr_scheduler="константа" \ --lr_warmup_steps=0 \ --max_train_steps=400

Предварительное сохранение используется, чтобы избежать переобучения и дрейфа языка. Пожалуйста, обратитесь к статье, чтобы узнать больше об этом, если вы заинтересованы. Для предварительного сохранения мы используем другие изображения того же класса в рамках тренировочного процесса. Приятно то, что мы можем генерировать эти изображения, используя саму модель стабильной диффузии! Сценарий обучения сохранит сгенерированные изображения по указанному нами локальному пути.

Приятно то, что мы можем генерировать эти изображения, используя саму модель стабильной диффузии! Сценарий обучения сохранит сгенерированные изображения по указанному нами локальному пути.

Согласно статье, рекомендуется генерировать num_epochs * num_samples изображений для предварительного сохранения. 200-300 хорошо работает в большинстве случаев.

экспорт MODEL_NAME="CompVis/stable-diffusion-v1-4" экспорт INSTANCE_DIR="path_to_training_images" экспорт CLASS_DIR="path_to_class_images" экспорт OUTPUT_DIR="path_to_saved_model" ускорить запуск train_dreambooth.py \ --pretrained_model_name_or_path=$MODEL_NAME \ --instance_data_dir=$INSTANCE_DIR \ --class_data_dir=$CLASS_DIR \ --output_dir=$OUTPUT_DIR \ --with_prior_preservation --prior_loss_weight=1,0 \ --instance_prompt="фото скс-собаки" \ --class_prompt="фото собаки" \ --разрешение=512 \ --train_batch_size=1 \ --gradient_accumulation_steps=1 \ --learning_rate=5e-6 \ --lr_scheduler="константа" \ --lr_warmup_steps=0 \ --num_class_images=200 \ --max_train_steps=800

Во время тренировки с Dreambooth легко перетренироваться, поэтому иногда полезно сохранять регулярные контрольные точки во время процесса. Одна из промежуточных контрольных точек может работать лучше, чем окончательная модель! Чтобы использовать эту функцию, вам нужно передать следующий аргумент сценарию обучения:

Одна из промежуточных контрольных точек может работать лучше, чем окончательная модель! Чтобы использовать эту функцию, вам нужно передать следующий аргумент сценарию обучения:

--checkpointing_steps=500

Это сохранит полное состояние обучения в подпапках вашего output_dir . Имена подпапок начинаются с префикса контрольная точка- , а затем количество выполненных шагов; например: контрольная точка-1500 будет контрольной точкой, сохраненной после 1500 шагов обучения.

Если вы хотите возобновить тренировку с любой из сохраненных контрольных точек, вы можете передать аргумент --resume_from_checkpoint , а затем указать имя контрольной точки, которую вы хотите использовать. Вы также можете использовать специальную строку «последняя» для возобновления с последней сохраненной контрольной точки (т. е. с наибольшим количеством шагов). Например, следующее возобновит тренировку с контрольной точки, сохраненной после 1500 шагов:

Например, следующее возобновит тренировку с контрольной точки, сохраненной после 1500 шагов:

--resume_from_checkpoint="checkpoint-1500"

Это хорошая возможность настроить некоторые из ваших гиперпараметров, если хотите.

Сохраненные контрольные точки сохраняются в формате, пригодном для возобновления обучения. Они включают не только веса модели, но и состояние оптимизатора, загрузчиков данных и скорость обучения.

Примечание : Если вы установили "accelerate>=0.16.0" , вы можете использовать следующий код для запуска

вывод из промежуточной контрольной точки.

из импорта диффузоров DiffusionPipeline, UNet2DConditionModel из трансформеров импортировать CLIPTextModel импортный факел # Загружаем пайплайн с теми же аргументами (модель, ревизия), которые использовались для обучения model_id = "CompVis/стабильная-диффузия-v1-4" unet = UNet2DConditionModel.from_pretrained("/sddata/dreambooth/daruma-v2-1/checkpoint-100/unet") # если вы тренировались с `--args.train_text_encoder`, обязательно загрузите кодировщик текста text_encoder = CLIPTextModel.from_pretrained("/sddata/dreambooth/daruma-v2-1/checkpoint-100/text_encoder") конвейер = DiffusionPipeline.from_pretrained (model_id, unet = unet, text_encoder = text_encoder, dtype = torch.float16) трубопровод.к("куда") # Выполнить вывод, сохранить или отправить в хаб pipe.save_pretrained("мечта-конвейер")

Если вы установили "accelerate<0.16.0" , вам необходимо сначала преобразовать его в конвейер вывода. Вот как вы можете это сделать:

от Accelerator Accelerator импорта из диффузоров импорт DiffusionPipeline # Загружаем пайплайн с теми же аргументами (модель, ревизия), которые использовались для обучения model_id = "CompVis/стабильная-диффузия-v1-4" конвейер = DiffusionPipeline.from_pretrained(model_id) ускоритель = ускоритель() # Использовать text_encoder, если для начального обучения использовался `--train_text_encoder` unet, text_encoder = accelerator.prepare(pipeline.unet, pipe.text_encoder) # Восстановить состояние из пути контрольной точки. Вы должны использовать абсолютный путь здесь. accelerator.load_state("/sddata/dreambooth/daruma-v2-1/checkpoint-100") # Перестроить конвейер с развернутыми моделями (присвоение .unet и .text_encoder тоже должно работать) конвейер = DiffusionPipeline.from_pretrained( модель_id, unet=accelerator.unwrap_model(unet), text_encoder=accelerator.unwrap_model(text_encoder), ) # Выполнить вывод, сохранить или отправить в хаб pipe.save_pretrained("мечта-конвейер")

С помощью градиентной контрольной точки и 8-битного оптимизатора от bitsandbytes можно обучить Dreambooth на графическом процессоре 16 ГБ.

pip install bitsandbytes

Затем передайте параметр --use_8bit_adam в сценарий обучения.

экспорт MODEL_NAME="CompVis/stable-diffusion-v1-4" экспорт INSTANCE_DIR="path_to_training_images" экспорт CLASS_DIR="path_to_class_images" экспорт OUTPUT_DIR="path_to_saved_model" ускорить запуск train_dreambooth.py \ --pretrained_model_name_or_path=$MODEL_NAME \ --instance_data_dir=$INSTANCE_DIR \ --class_data_dir=$CLASS_DIR \ --output_dir=$OUTPUT_DIR \ --with_prior_preservation --prior_loss_weight=1,0 \ --instance_prompt="фото скс-собаки" \ --class_prompt="фото собаки" \ --разрешение=512 \ --train_batch_size=1 \ --gradient_accumulation_steps=2 --gradient_checkpointing \ --use_8bit_adam \ --learning_rate=5e-6 \ --lr_scheduler="константа" \ --lr_warmup_steps=0 \ --num_class_images=200 \ --max_train_steps=800

Скрипт также позволяет точно настроить text_encoder вместе с unet . Экспериментально было замечено, что это дает гораздо лучшие результаты, особенно на лицах. Пожалуйста, обратитесь к нашему блогу для более подробной информации.

Чтобы включить эту опцию, передайте аргумент --train_text_encoder обучающему сценарию.

Для обучения текстового кодировщика требуется дополнительная память, поэтому обучение не подходит для 16-гигабайтного графического процессора. Для использования этой опции вам потребуется не менее 24 ГБ видеопамяти.

Для использования этой опции вам потребуется не менее 24 ГБ видеопамяти.

экспорт MODEL_NAME="CompVis/stable-diffusion-v1-4" экспорт INSTANCE_DIR="path_to_training_images" экспорт CLASS_DIR="path_to_class_images" экспорт OUTPUT_DIR="path_to_saved_model" ускорить запуск train_dreambooth.py \ --pretrained_model_name_or_path=$MODEL_NAME \ --train_text_encoder \ --instance_data_dir=$INSTANCE_DIR \ --class_data_dir=$CLASS_DIR \ --output_dir=$OUTPUT_DIR \ --with_prior_preservation --prior_loss_weight=1,0 \ --instance_prompt="фото скс-собаки" \ --class_prompt="фото собаки" \ --разрешение=512 \ --train_batch_size=1 \ --use_8bit_adam --gradient_checkpointing \ --learning_rate=2e-6 \ --lr_scheduler="константа" \ --lr_warmup_steps=0 \ --num_class_images=200 \ --max_train_steps=800

С помощью DeepSpeed можно даже разгрузить некоторые

тензоры из VRAM в ЦП или NVME, что позволяет проводить обучение с меньшим объемом памяти графического процессора.

DeepSpeed должен быть включен с помощью конфигурации ускорения . Во время настройки

ответьте «да» на «Вы хотите использовать DeepSpeed?». Объединение DeepSpeed stage 2, fp16

смешанной точности и разгружая как параметры модели, так и состояние оптимизатора на ЦП, это

можно тренироваться на менее чем 8 ГБ видеопамяти. Недостатком является то, что для этого требуется больше системной оперативной памяти (около 25 ГБ). Дополнительные параметры конфигурации см. в документации DeepSpeed.

Замена оптимизатора Adam по умолчанию на специальную версию Adam от DeepSpeed deepspeed.ops.adam.DeepSpeedCPUAdam обеспечивает существенное ускорение, но позволяет

для этого требуется, чтобы версия цепочки инструментов CUDA системы была такой же, как и версия, установленная с PyTorch. В настоящее время 8-битные оптимизаторы не совместимы с DeepSpeed.

экспорт MODEL_NAME="CompVis/stable-diffusion-v1-4" экспорт INSTANCE_DIR="path_to_training_images" экспорт CLASS_DIR="path_to_class_images" экспорт OUTPUT_DIR="path_to_saved_model" ускорить запуск train_dreambooth.py \ --pretrained_model_name_or_path=$MODEL_NAME \ --instance_data_dir=$INSTANCE_DIR \ --class_data_dir=$CLASS_DIR \ --output_dir=$OUTPUT_DIR \ --with_prior_preservation --prior_loss_weight=1,0 \ --instance_prompt="фото скс-собаки" \ --class_prompt="фото собаки" \ --разрешение=512 \ --train_batch_size=1 \ --sample_batch_size=1 \ --gradient_accumulation_steps=1 --gradient_checkpointing \ --learning_rate=5e-6 \ --lr_scheduler="константа" \ --lr_warmup_steps=0 \ --num_class_images=200 \ --max_train_steps=800 \ --mixed_precision=fp16

После обучения модели вывод можно сделать с помощью StableDiffusionPipeline , просто указав путь, по которому была сохранена модель. Убедитесь, что ваши подсказки включают специальный идентификатор , используемый во время обучения ( sks в предыдущих примерах).

Примечание : Если вы установили "accelerate>=0.16.0" , вы можете использовать следующий код для запуска

вывод из промежуточной контрольной точки.